“Um computador é capaz de pensar?”, continuamos nos perguntado, quase 70 anos após o famoso jogo da imitação de Alan Turing [1], e continuam, como sabemos, os dilemas que estão na base da pergunta: mente e cérebro são “substâncias distintas”? O que é, afinal a consciência? É possível pensá-la como algo independente de um corpo biológico? [2]

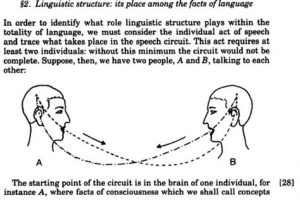

O jogo da imitação, mais adiante batizado de teste de Turing, como sabemos, era baseado numa espécie de conversa, bastante simplificada, composta de perguntas e respostas feitas a um interlocutor que poderia ser um ser humano ou um computador (inicialmente, no artigo de Turing, um homem ou uma mulher). Assim, de início, a linguagem é vista, entre os precursores das ciências da computação, não como uma prática social, gestos de significação ideologicamente saturados ou negociação de sentidos/jogos de linguagem entre sujeitos situados, mas uma sequencia de correspondências entre palavras que solicitam fatos e outras palavras que os transmitem, isto é, um ato comunicativo, de troca de mensagens, não um ato de fala, de enunciação ou de cognição situada.

Por isso, também, o estudioso da linguagem têm dificuldade em conceber linguagens de computador como linguagens (seriam códigos, já que não possuem dupla articulação, nem podem gerar um numero infinito de sentenças com sentido a partir de um numero finito de elementos léxico-sintáticos) ou inteligência artificial como inteligência (já que inteligência, no caso do sujeito da linguagem, pressupõe consciência sobre efeitos de sentido devidos às suas escolhas de palavras que englobam o que possa mudar no mundo a partir daí) ou mesmo aprendizagem de máquina como aprendizagem (porque adquirir ou aprender uma língua não é sobre imitar comportamentos certos com a frequência correta em situações corretas, apenas, mas ativar estruturas plásticas da mente-cérebro permitirão criar, com compreensão, enunciados que nunca poderiam ter sido escutados, e portanto imitados, antes).

Não obstantes essas constatações, observamos hoje, a todo momento, pessoas e computadores “conversando” nas mais variadas situações, voluntariamente ou de maneira forçosa, como com as famosas URAs (Unidade de Resposta Audível) dos serviços de atendimento telefonônico, num jogo em que o humano projeta sobre a troca de símbolos uma coerência linguística que o computador não alcança, diante do que o computador diz baseado em cálculos probabilísticos que, por sua vez, o falante humano não conseguiria fazer “de cabeça”. Logo, a visão de linguagem na base da cibernética vingou, apesar de tudo, como uma forma específica de prática discursiva contemporânea, uma forma seminal, talvez, do que será efetivamente a linguagem pós-humana, numa sociedade em que a distinção entre agentes cognitivo-discursivos humanos e não-humanos não teria mais sentido.

A linguagem em uso passar a ser uma integração “sofrida” desses dois conjuntos de rotinas e capacidades voltados para metas definidas, como todo sistema cibernético.

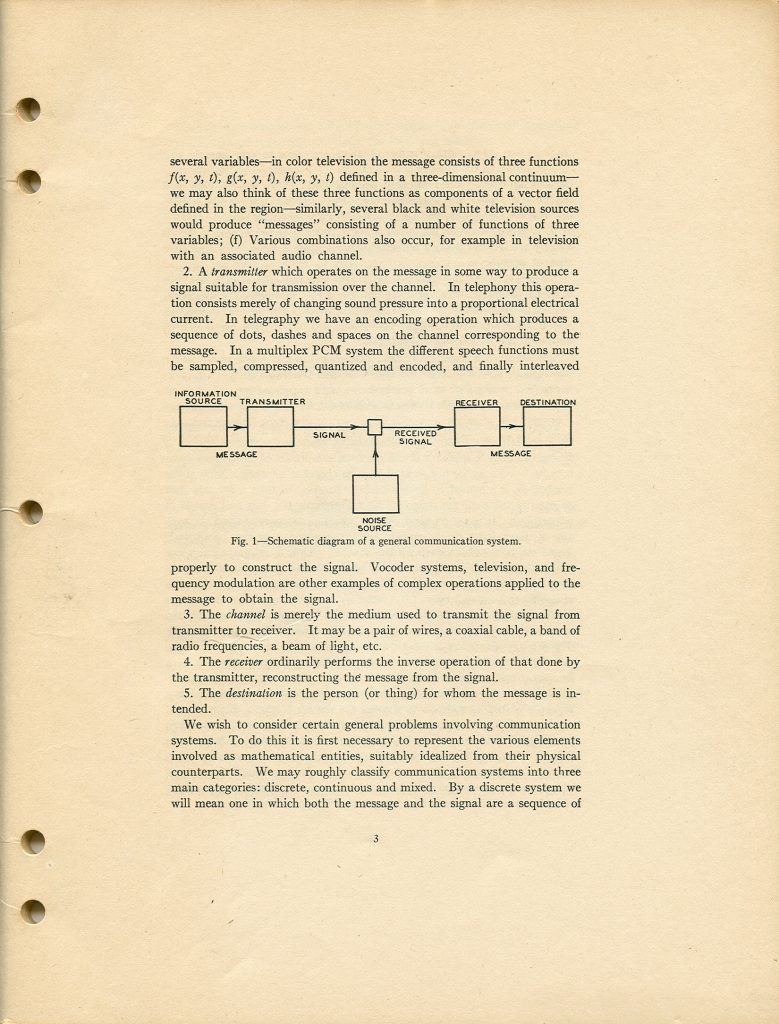

No livro, Wiener [3], um dos pais da cibernética, faz inúmeras referencias à linguagem, sempre concebendo-a, de forma reducionista, como troca de mensagens com sentido pré-definido. Mensagens, por sua vez, seriam arranjos codificados de símbolos cuja forma/ordem fornece informação, isto é, possibilidades de combinação não aleatória, não conteúdos sobre algum estado de coisas concebido por um falante, ou seja, uma noção trazida da então emergente TeMatemática da Informação [4].

Para Wiener, “A linguagem é, em certo sentido, outro nome para a própria comunicação, assim como uma palavra usada para descrever os códigos por meio dos quais se processa a comunicação” (p. 73). Mesmo naqueles idos dos anos 1950, já se poderia ver aí uma manobra até certo ponto arbitrária, cujas consequências seriam ainda mais significativas a partir do passo seguinte: declarar comunicação e controle como sinônimos. [CONTINUA NA PARTE 2/3]

[1] TURING, A. M. Computing Machinery and Intelligence. Mind, v. LIX, n. 236, p. 433–460, 1950.

[2] TEIXEIRA, J. DE F. O cérebro e o robô: inteligência artificial, biotecnologia e a nova ética. São Paulo: Paulus, 2015.

[3] WIENER, N. Cibernética e sociedade: o uso humano de seres humanos. São Paulo: Cultrix, 1970.

[4] SHANNON, C. E.; WEAVER, W. The mathematical theory of communication. Urbana: University of Illinois Press, 1975.